A mulher estava imóvel, exceto pelas subidas e descidas da sua respiração. Seus olhos estavam fixos e concentrados e as mãos fechadas como em um soco. Palavras se formavam em uma tela à sua frente e se reuniam lentamente, formando frases inteiras, que ela não conseguia dizer em voz alta.

Ela tem 52 anos de idade e ficou paralisada por um AVC 19 anos antes, sem poder falar com clareza. Mas, agora, seu monólogo interno aparecia em frente aos seus olhos.

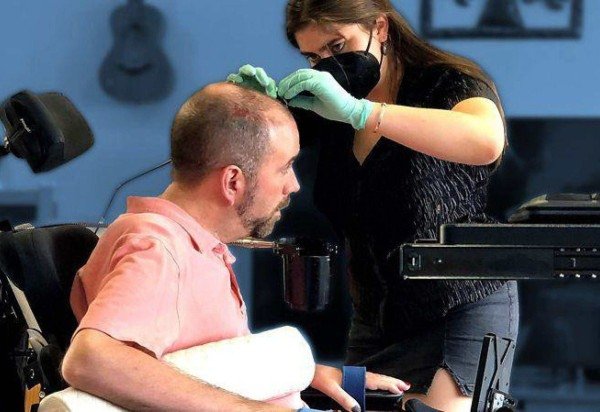

Identificada apenas como participante T16, a mulher recebeu um minúsculo feixe de eletrodos, inserido cirurgicamente em um lóbulo na frente do cérebro.

Agora, um computador, alimentado por uma forma de inteligência artificial, decodifica os sinais produzidos pelos seus neurônios enquanto ela imagina dizer palavras. O sistema traduz os sinais em texto e mostra em uma tela.

Ela fez parte de um estudo da Universidade de Stanford, no Estado americano da Califórnia, ao lado de três outros pacientes com a doença neurodegenerativa esclerose lateral amiotrófica (ELA). O objetivo é testar uma técnica capaz de traduzir pensamentos em texto, em tempo real.

Foi o mais próximo que os cientistas já chegaram de uma forma de "ler pensamentos".

Os pesquisadores publicaram suas realizações em agosto de 2025. Alguns meses depois, pesquisadores japoneses revelaram uma técnica de "legendar a mente", capaz de gerar descrições precisas e detalhadas do que uma pessoa está observando ou imaginando.

Ela combina três ferramentas de IA diferentes com imagens cerebrais não invasivas para traduzir a atividade cerebral da pessoa.

Estes dois estudos são os mais recentes de uma série de inovações que vêm oferecendo aos neurocientistas uma nova visão do funcionamento interno do cérebro humano e fornecendo oportunidades de ajudar pessoas incapazes de se comunicar de outra maneira.

Algum dia, estes avanços poderão transformar radicalmente a forma como todos nós interagimos com o mundo à nossa volta e até entre nós mesmos.

"Nos próximos anos, começaremos a ver essas tecnologias sendo comercializadas e implementadas em escala", afirma a neuroengenheira Maitreyee Wairagkar, que desenvolve interfaces entre o cérebro e computadores no laboratório de neuropróteses da Universidade da Califórnia em Davis, nos Estados Unidos.

Diversas empresas, incluindo a Neuralink, de Elon Musk, já procuram produzir chips cerebrais comerciais que trarão esta tecnologia do laboratório para o mundo real.

"É fascinante", afirma Wairagkar.

Os cientistas vêm desenvolvendo dispositivos capazes de se comunicar diretamente com o cérebro humano há muito tempo. Eles são conhecidos como interfaces entre o computador e o cérebro (BCIs, na sigla em inglês).

Em 1969, o neurocientista americano Eberhard Fetz demonstrou que macacos conseguem aprender a mover a agulha de um medidor com a atividade de um único neurônio no cérebro, se receberem um alimento em troca.

Em um experimento mais idiossincrático da mesma época, o cientista espanhol José Delgado (1915-2011) conseguiu estimular remotamente o cérebro de um touro enfurecido, fazendo com que ele parasse a meio caminho.

Os BCIs conseguiram há décadas decodificar os sinais cerebrais que acompanham o movimento, de forma que os usuários possam controlar um membro protético ou cursor em uma tela.

Mas o desenvolvimento de BCIs que traduzem sinais de fala ou outros pensamentos complexos dos sinais cerebrais caminha com mais lentidão.

"Grande parte do trabalho inicial foi feita em primatas não humanos... e, obviamente, você não pode estudar a fala com macacos", explica Wairagkar.

Mas, nos últimos anos, este campo fez avanços impressionantes rumo à decodificação da fala das pessoas com capacidades comunicativas debilitadas. É o caso de pacientes que sofrem de ELA, que traz paralisia e a síndrome do encarceramento.

Pesquisadores da Universidade de Stanford anunciaram em 2021, por exemplo, uma prova de conceito bem sucedida que permitiu a um homem quadriplégico produzir frases em inglês, ao se imaginar desenhando letras no ar com sua mão. Com este método, ele conseguiu escrever 18 palavras por minuto.

A fala humana natural é de cerca de 150 palavras por minuto. Por isso, a próxima etapa seria decodificar palavras da atividade neural associada à própria fala.

Em 2024, o laboratório de Wairagkar testou uma técnica que traduzia as tentativas de fala de um homem de 45 anos de idade com ELA, diretamente em texto na tela de um computador.

Com cerca de 32 palavras por minuto e 97,5% de precisão, esta foi a primeira demonstração de como os BCIs de fala poderão ajudar na comunicação diária, segundo Wairagkar.

Estes métodos usam "conjuntos" minúsculos de microeletrodos, implantados cirurgicamente na superfície do cérebro.

Esses conjuntos registram padrões da atividade neural da área do cérebro onde são colocados e os sinais são convertidos em significado por um algoritmo de computador.

É aqui que o poder do aprendizado de máquina (um tipo de inteligência artificial) foi transformador. Os algoritmos são capazes de reconhecer padrões em imensas quantidades de dados disparatados.

No caso da decodificação da fala, os algoritmos de aprendizado de máquina são treinados para reconhecer padrões de atividade neural associados a diferentes fonemas, que são os menores blocos de construção da linguagem.

Pesquisadores compararam este sistema com o processamento que ocorre em assistentes inteligentes, como a Alexa, da Amazon. Mas, em vez de interpretar sons, a IA interpreta sinais neurais.

Revelando a fala interior

Por mais impressionantes que sejam esses esforços recentes de decodificação da fala, permanecem alguns empecilhos.

Normalmente, os pacientes necessitariam tentar dizer as palavras que gostariam de comunicar, mesmo se não fossem fisicamente capazes de fazê-lo, para que elas sejam traduzidas com precisão pela tecnologia dos BCIs.

Isso ocorre porque os eletrodos são normalmente colocados no córtex motor, que é a área responsável pelos movimentos dos músculos. Mas tentar falar requer esforço, o que torna o processo de comunicação lento e difícil.

Para sua última tentativa, os pesquisadores da Universidade de Stanford quiseram testar se havia uma forma mais fácil: se eles poderiam projetar um método que detectasse a "fala interior" em tempo real, além da "tentativa de fala".

"Pedimos que eles contassem o número de formas de uma certa cor na tela, pois imaginávamos que você provavelmente realizaria este tipo de tarefa contando literalmente os números na cabeça", explica Frank Willett, um dos diretores do Laboratório de Tradução Protética Neural da Universidade de Stanford. Ele também foi um dos autores do estudo envolvendo a mulher mencionada no início desta reportagem.

"E foi o que observamos. Vimos traços desses números passando através do córtex motor, que conseguimos captar."

A resposta se a tecnologia conseguiria identificar a fala interior é um "sim" provisório.

Para uma tarefa que envolve imaginar uma frase, os pesquisadores conseguiram atingir índice de precisão de até 74% em tempo real. Já nas tarefas projetadas para estimular a fala interior espontânea, a precisão diminuiu, mas ainda ficou bem acima do simples acaso.

No entanto, em condições mais abertas, oferecendo aos participantes instruções como "pense na sua fala favorita de um filme", a linguagem decodificada foi praticamente incompreensível.

"Sem a tecnologia atual, não conseguimos entender a fala interior totalmente não filtrada de uma pessoa com precisão perfeita", afirma Willett. "Mas conseguimos captar traços de fala interior de forma bastante clara nessas tarefas distintas."

O estudo demonstrou ainda como a fala interior pode funcionar no nosso cérebro. Ele descobriu que os padrões neurais da fala interior apresentam alta correlação com os da tentativa de fala no córtex motor, mas que os sinais emitidos são mais fracos.

Isso confirma estudos anteriores de eletrofisiologia e neuroformação de imagens, que concluíram que a fala interior usa uma rede cerebral similar à da fala produzida fisicamente.

Além das palavras

O laboratório de Wairagkar na Universidade da Califórnia em Davis fez uma importante descoberta em 2025, Ele demonstrou que poderia não só decodificar palavras, mas também os elementos não verbais da fala, como a entonação, o tom, o ritmo e a velocidade.

Essencialmente, isso permitiria aos pacientes comunicar expressões e ênfase, além das palavras em si.

"A fala humana é muito mais do que texto sobre tela", explica Wairagkar.

"A maior parte da nossa comunicação vem de como falamos, como nos expressamos. O que dizemos tem significados diferentes em contextos distintos."

Wairagkar e seus colegas demonstraram que seu protótipo pode produzir fala em voz alta, como tenta fazer um paciente de ELA com grave distúrbio motor da fala.

Basicamente, o participante conseguiu modular suas palavras para transmitir significado.

"Nosso participante conseguiu fazer uma questão com inflexão no final da sentença e mudar de tom enquanto falava", explica Wairagkar. "Demonstramos isso com uma tarefa simples, na qual ele cantava melodias."

Não foi perfeito, mas os responsáveis pelos testes consideraram que 60% das palavras foram inteligíveis.

Ainda serão necessários novos progressos para chegarmos à melhor tecnologia de transmissão do cérebro para texto, mas o teste demonstrou que isso poderá ser possível no futuro próximo.

Wairagkar e Willett acreditam que novos progressos são iminentes. Um caminho para a melhoria poderá envolver simplesmente o aumento da quantidade de microeletrodos colocados no cérebro.

"No nosso cérebro, temos bilhões de neurônios e trilhões de conexões", destaca Wairagkar. E, no seu estudo mais recente, "estamos trabalhando com uma amostra de apenas 256 deles".

"Dispositivos mais novos e melhor tecnologia conseguirão usar amostras com mais neurônios, obter maior riqueza de informação e atingir fala inteligível em tempo real", acrescenta ela.

Willett tem interesse em explorar ainda mais particularmente a fala interior. Seus planos são de pesquisar como outras áreas do cérebro, fora do córtex motor, podem estar envolvidas.

"Uma área de interesse para nós é o giro temporal superior", explica ele.

Willett se refere a uma área do cérebro envolvida no processamento auditivo, que também poderá participar da fala interna, como "as representações auditivas do que você imagina ouvir dentro da sua cabeça".

Observar além do córtex motor também poderá ser importante para ajudar as pessoas que têm lesões cerebrais nesta região, como vítimas de AVC, cujo córtex motor está danificado, mas ainda conseguem entender a fala.

Descobrir outras áreas do cérebro envolvidas na fala interior também poderá, um dia, ajudar essas pessoas a se comunicar, destaca Willett.

Ver para crer

Enquanto os pesquisadores de interfaces entre o computador e o cérebro se concentram nas aplicações práticas da tecnologia que podem ajudar os pacientes, existem outros campos fazendo progressos com a decodificação de imagens cerebrais e nos ajudando a compreender melhor o funcionamento do cérebro.

Uma área de pesquisa se concentra na recriação de imagens observadas por indivíduos, simplesmente analisando as imagens cerebrais com IA.

Funciona assim: os participantes observam imagens enquanto sua atividade cerebral é registrada por meio de imagens de ressonância magnética funcional (fMRI, na sigla em inglês). Esta técnica mede a atividade cerebral, detectando alterações do fluxo sanguíneo para diferentes regiões do cérebro.

Os dados neurais são decodificados em seguida por um algoritmo e alimentados para um gerador de imagens por IA, que tenta reproduzir as imagens observadas pelo paciente.

Os pesquisadores vêm tentando montar este quebra-cabeça há décadas, mas o boom da IA generativa nos últimos anos trouxe avanços significativos neste setor.

Os geradores mais recentes de imagens por IA, como o Stable Diffusion, melhoraram imensamente a qualidade das imagens produzidas.

O professor Yu Takagi, do Instituto de Tecnologia de Nagoya, no Japão, publicou um estudo em 2023 seguindo este método, com um algoritmo do Stable Diffusion.

O algoritmo foi treinado com base em um conjunto de dados online criado pela Universidade de Minnesota, nos Estados Unidos. Ele consiste de imagens do cérebro de quatro participantes, tiradas enquanto cada um deles observava um conjunto de 10 mil fotos.

Em muitos casos, a IA conseguiu fornecer uma impressão adequada da imagem original, apesar de ter ficado completamente perplexa com uma tigela de salada.

Este campo segue avançando rapidamente. Pesquisadores de Israel publicaram um estudo no ano passado que conseguiu reproduzir imagens ainda mais precisas.

Estes estudos ajudaram a esclarecer como o cérebro processa informações visuais, segundo Takagi. A conclusão foi que duas partes distintas do cérebro são fundamentais.

O lobo occipital, localizado na parte de trás do cérebro, codifica os aspectos visuais "de baixo nível" de uma imagem, como o layout, a perspectiva e a cor. Paralelamente, o lobo temporal, que fica atrás das têmporas, codifica elementos conceituais "de alto nível", envolvidos na classificação do que é realmente um objeto.

O som da música

Também existem estudos em andamento para reconstruir experiências auditivas.

Em 2025, Takagi publicou um estudo que empregou um algoritmo de propriedade do Google para tentar reproduzir áudio a partir de imagens de fRMI produzidas enquanto os pacientes ouviam trechos de músicas.

Takagi afirma que este pode ser um desafio maior do que reconstruir imagens, pois a música muda constantemente, enquanto o aparelho de fMRI só consegue produzir imagens completas em intervalos de um segundo.

"A qualidade da reconstrução é menor, em comparação com a reconstrução de imagens", explica ele. "Mas ainda conseguimos reconstruir as características e a categoria básica da música."

Este campo aumentou nosso conhecimento das bases neurais da percepção musical.

"O que nos surpreendeu neste estudo é que a percepção da música no cérebro é diferente da percepção de imagens", explica Takagi.

"Para as imagens, as informações de alto e baixo nível possuem locais distintos no cérebro. Para a música, descobrimos que a semântica e as informações de baixo nível não ficam separadas."

Takagi está empolgado com algumas das possíveis aplicações destas técnicas.

Elas poderão recriar as alucinações visuais e auditivas de pacientes psiquiátricos, como esquizofrênicos, para entendermos melhor a sua condição, segundo ele. E as técnicas poderão ser usadas para recriar as experiências dos animais enquanto processam o mundo ou até para reconstruir sonhos.

"Muitas pessoas estão pedindo isso", diz Takagi, rindo.

Ele conta que gostaria de recriar sonhos algum dia. Mas, por enquanto, parece extremamente complicado.

Pesquisas chegaram a levantar a possibilidade de comunicação direta entre um cérebro e outro ou até com diversas pessoas de uma vez. Mas as implicações éticas e questões de direitos humanos relacionadas aos aparelhos que oferecem esta possibilidade ainda precisam ser totalmente analisadas.

E, para quem espera que também seja possível estimular experiências visuais ou auditivas no cérebro em nome do entretenimento, Takagi pede paciência.

Teoricamente, isso é possível, mas ele afirma que limitações técnicas indicam que, provavelmente, não irá acontecer nos próximos 10 a 20 anos.

Leia a versão original desta reportagem (em inglês) no site BBC Technology.

- Como 8 segundos em fita de VHS devolveram voz a mulher com doença degenerativa após 25 anos

- Como implante cerebral Neuralink de Elon Musk 'amplia as fronteiras da mente'

- A tecnologia pode fazer cérebro funcionar melhor?

- Como podemos retardar o envelhecimento do nosso cérebro, segundo cientistas