Deepfake é uma técnica que utiliza inteligência artificial para criar fotos, vídeos e áudios falsos por meio da combinação entre eles. A palavra é composta pela junção de deep learning (aprendizagem profunda) e fake (falso). De acordo com Igor Lemes, estudante de matemática computacional na Universidade Federal de Minas Gerais (UFMG), a técnica é feita com programas que processam dados e repetem padrões.

"Primeiro, é necessário entender que deep learning é um tipo de inteligência artificial que foi criado com a intenção de simular o funcionamento dos nossos neurônios, ainda que esteja muito longe de fazê-lo. Com uma rede de neurônios artificiais, o programa é capaz de processar dados e aprender padrões existentes nesses dados, e alguns são feitos para imitar esses padrões. Assim, quanto mais neurônios e mais dados, mais essa rede consegue aprender e criar", explica Igor.

Por causa da capacidade de reconhecer padrões, os programas que utilizam a técnica de aprendizagem profunda são usados na coloração de imagens em preto e branco, reconhecimento de voz e são úteis até na análise de imagens médicas para identificar possíveis tumores cancerígenos.

"Porém, essa mesma capacidade de aprender padrões em grandes quantidades de dados é usada para aprender a reconhecer o rosto humano através de diversos mecanismos, sendo um deles o uso de pontos de referência, como boca, nariz, olhos, sobrancelhas entre outros", alerta Igor.

Ele explica, ainda, que ao juntar os padrões das expressões faciais da pessoa, o programa susbtitui a face utilizando fotos de outro indivíduo. "O programa consegue substituir a face em todo o vídeo, emulando todas as expressões como se ele estivesse sido gravado", pontua.

Quais são os riscos da técnica?

O jornalista Bruno Sartori utiliza a técnica de deepfake há quase cinco anos para criar sátiras políticas. "No final de 2017 eu trombei com a tecnologia, eu já trabalhava na minha cidade com vídeos de humor e quando vi a técnica sendo utilizada pensei: 'isso pode ser usado no meu trabalho e dará mais qualidade', foi assim que comecei a entender e trabalhar o uso", conta ao Correio.

Bruno reconhece, no entanto, que o uso mal intencionado de deepfake pode gerar riscos. Isso porque a técnica pode ser usada para modificar fala ou gestos de indivíduos. "Essa tecnologia poderá ser utilizada durante as eleições para se criar fake news. Já pensou algum candidato assumindo um crime?", destaca o especialista.

A dois meses das eleições, a manipulação de conteúdos audiovisuais preocupa, visto que esses atos podem intensificar a propagação de desinformação. De acordo com Guilherme Pinheiro, advogado e pesquisador do Centro de Direito, Internet e Sociedade do Instituto Brasileiro de Ensino, Desenvolvimento e Pesquisa (IDP), deepfakes podem ser utilizadas com o intuito de atrapalhar o processo eleitoral deste ano. "Tudo isso pode ter impacto forte nas eleições, ainda mais na véspera do pleito, quando não há mais tempo hábil para que a deepfake seja desmentida", ressalta.

Como a legislação brasileira trata do tema?

Guilherme Pinheiro, pós-doutor em direito, explica que não há um tipo penal específico para deepfake no Brasil. "Existem ações de indenização civil, caso haja dano moral ou à imagem da pessoa. Do ponto de vista do Marco Civil da Internet, há a possibilidade de requerer que as redes sociais excluam esses conteúdos, mediante ordem judicial". O especialista cita a lei 13.718/2018, que diz que a publicação de imagens de cunho sexual, sem autorização da pessoa, é configurada como crime.

"Art. 218-C. Oferecer, trocar, disponibilizar, transmitir, vender ou expor à venda, distribuir, publicar ou divulgar, por qualquer meio - inclusive por meio de comunicação de massa ou sistema de informática ou telemática -, fotografia, vídeo ou outro registro audiovisual que contenha cena de estupro ou de estupro de vulnerável ou que faça apologia ou induza a sua prática, ou, sem o consentimento da vítima, cena de sexo, nudez ou pornografia:<br>Pena - reclusão, de 1 (um) a 5 (cinco) anos, se o fato não constitui crime mais grave."

"Dentro disso está, inclusive, as montagens, o que inclui o deepfake", explica Guilherme. "Deepfake é uma tecnologia, então ela pode ser usada para cometer os mais diversos tipos de crimes. Ela não é, em si, ilegal, mas pode ser usada para fins ilícitos", acrescenta o pesquisador. Recentemente, o rosto da cantora Anitta foi inserido em um vídeo pornográfico. "No material em que Anitta é inserida criminosamente, é possível notar a sobreposição do rosto quando uma unha desaparece ao passar sobre a boca", explicou o jornalista Bruno Sartori nas redes sociais.

Saiba Mais

Como identificar deepfake?

Igor Lemes ressalta que, com o aprimoramento dos algoritmos, fica cada vez mais difícil reconhecer uma deepfake. "Um dos fatores que impacta muito na habilidade de identificar um deepfake é a quantidade de imagens presentes na internet da pessoa cujo rosto foi colocado no vídeo. Quanto mais imagens, mais difícil a identificação, o que acaba sendo um problema para pessoas públicas, já que é muito fácil encontrar fotos delas na internet", diz.

Um estudo publicado em 2021, pelo Instituto Max Planck e pela Universidade de Amsterdã, mostrou que as pessoas tendem a confundir deepfakes com vídeos autênticos. "Em 11 dos 16 vídeos utilizados no estudo, os chutes dos participantes não têm muita diferença de chutes aleatórios. E mesmo nos outros 5, a porcentagem de acerto não foi significativamente superior. Além disso, os pesquisadores concluíram que as pessoas superestimam suas próprias capacidades de identificar os vídeos falsos, o que pode ser perigoso, já que deepfakes são tão comuns ultimamente", pontua o estudante de matemática computacional acerca da pesquisa internacional.

De acordo com informações da Agência Lupa e da organização Witness, cabe analisar o movimento do piscar dos olhos da pessoa em um vídeo, pois movimentações exageradas podem indicar a manipulação do conteúdo. Outra técnica apontada é a análise da pulsação. "Amplificando poucos pixels de um vídeo é possível ver se a cor de sua pele se altera conforme a passagem do sangue. Essa alteração tem que existir e ser constante. Caso não haja, o deepfake fica comprovado. O mesmo tipo de análise pode ser feito com a respiração", explica a agência de checagem.

Além disso, os próprios algoritmos de deep learning podem ser usados na identificação da origem de determinado conteúdo audiovisual. "Porém, esta estratégia está em fase de pesquisa e ainda não há modelos altamente eficientes", diz Igor Lemes.

Para ajudar nesse processo de identificação, o Google criou um banco de dados com mais de 3 mil vídeos deepfakes, o FaceForensics++. "FaceForensics++ é um conjunto de dados forenses que consiste em sequências de vídeo originais que foram manipuladas com quatro métodos automatizados de manipulação de rosto: Deepfakes, Face2Face, FaceSwap e NeuralTextures. Os dados foram obtidos de vídeos do youtube e todos os vídeos contêm uma face frontal rastreável, sem oclusões, o que permite métodos de adulteração automatizados para gerar falsificações realistas", informa a empresa.

Saiba Mais

-

![]() Política

Câmara aprova urgência para PL que obriga rastreamento de pets em viagens

Política

Câmara aprova urgência para PL que obriga rastreamento de pets em viagens

-

![]() Política

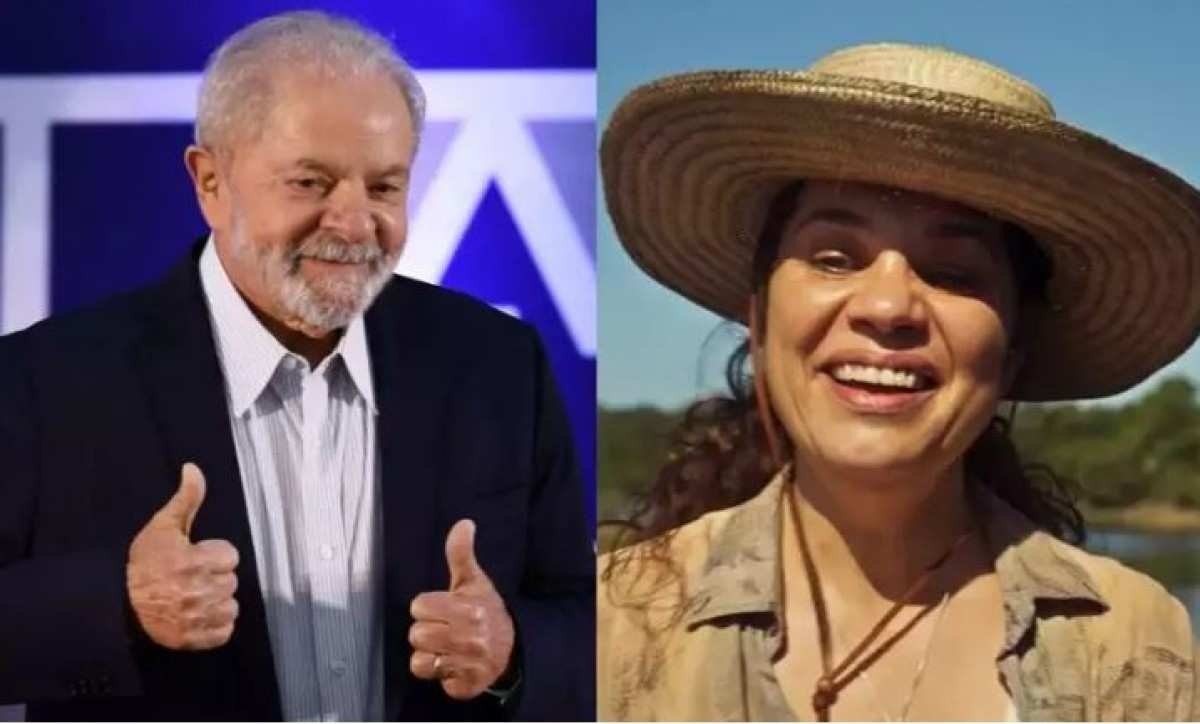

Lula sobre 'Pantanal': 'Choro com a história de Maria Bruaca'

Política

Lula sobre 'Pantanal': 'Choro com a história de Maria Bruaca'

-

![]() Mundo

O extraordinário impacto da erupção de vulcão submarino na atmosfera terrestre

Mundo

O extraordinário impacto da erupção de vulcão submarino na atmosfera terrestre

-

![]() Mundo

Jogadora de basquete Brittney Griner vai recorrer de condenação 'absurda'

Mundo

Jogadora de basquete Brittney Griner vai recorrer de condenação 'absurda'

Notícias pelo celular

Receba direto no celular as notícias mais recentes publicadas pelo Correio Braziliense. É de graça. Clique aqui e participe da comunidade do Correio, uma das inovações lançadas pelo WhatsApp.

Dê a sua opinião

O Correio tem um espaço na edição impressa para publicar a opinião dos leitores. As mensagens devem ter, no máximo, 10 linhas e incluir nome, endereço e telefone para o e-mail sredat.df@dabr.com.br.

Revista do Correio

Revista do Correio

Política

Política

Política

Política

Política

Política

Mundo

Mundo

Mundo

Mundo